Saviez-vous qu’Anthropic vient de modifier sa politique de confidentialité pour pouvoir entraîner Claude sur vos conversations d’entreprise ? Cette décision, qui suit la tendance générale du secteur, soulève des questions cruciales sur la protection des données sensibles dans l’usage professionnel de l’IA.

À retenir

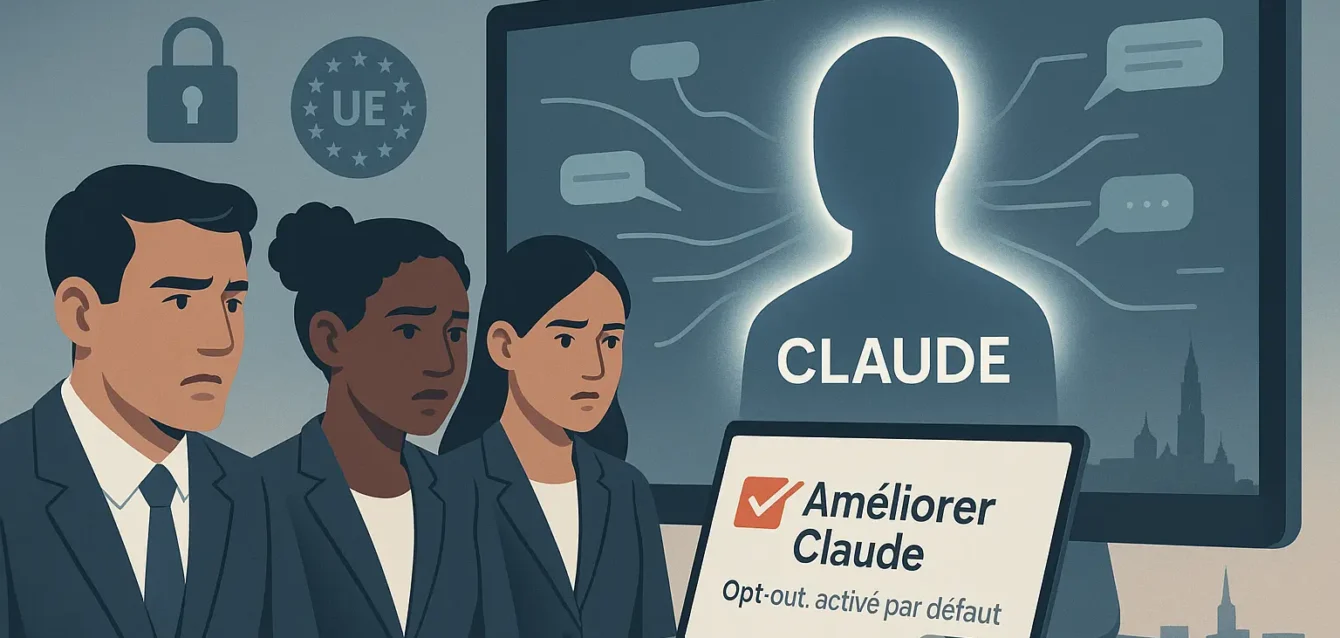

• Changement majeur : Anthropic collecte désormais par défaut les données des utilisateurs pour améliorer Claude, sauf opposition explicite

• Impact entreprises : Vos conversations professionnelles peuvent servir à entraîner l’IA, soulevant des enjeux de confidentialité

• Solution simple : Une case à décocher dans les paramètres permet de refuser cette collecte de données

• Tendance générale : Cette pratique s’aligne sur celle d’autres acteurs majeurs comme OpenAI et Google

• Enjeu stratégique : La maîtrise de ces paramètres devient cruciale pour protéger la propriété intellectuelle de votre entreprise

Table des matières

- Le changement de politique d’Anthropic : ce qui change concrètement

- Pourquoi cette évolution était prévisible dans le secteur de l’IA

- Les risques pour les entreprises belges utilisant Claude

- Comment protéger vos données d’entreprise dès maintenant

- Vers une approche plus sécurisée de l’IA en entreprise

Le changement de politique d’Anthropic : ce qui change concrètement

Depuis octobre 2024, Anthropic a modifié ses conditions d’utilisation de Claude pour permettre l’usage des conversations utilisateurs dans l’amélioration de son modèle d’IA. Cette évolution marque un tournant significatif pour l’entreprise qui se positionnait jusqu’alors comme plus respectueuse de la vie privée que ses concurrents.

Concrètement, toutes vos conversations avec Claude peuvent désormais être analysées et utilisées pour entraîner les futures versions du modèle. Cette approche, appelée « opt-out », signifie que la collecte est activée par défaut et que c’est à l’utilisateur de la désactiver s’il le souhaite.

Pour les entreprises, cette modification n’est pas anodine. Vos échanges sur des projets stratégiques, vos processus internes ou vos innovations peuvent potentiellement enrichir la base de connaissances d’une IA accessible à vos concurrents. Une réalité qui nécessite une vigilance accrue dans l’utilisation professionnelle de ces outils.

L’entreprise justifie cette décision par la nécessité d’améliorer continuellement ses modèles pour rester compétitive face à OpenAI et Google, deux géants qui collectent déjà massivement les données de leurs utilisateurs.

Pourquoi cette évolution était prévisible dans le secteur de l’IA

Le secteur de l’intelligence artificielle traverse actuellement une course à l’armement technologique sans précédent. Les données d’entraînement constituent le carburant de cette compétition, et leur qualité détermine directement les performances des modèles.

OpenAI utilise les conversations ChatGPT pour améliorer ses modèles depuis 2022, générant des revenus estimés à 1,3 milliard de dollars en 2024. Google fait de même avec Bard, désormais intégré à Gemini, s’appuyant sur l’écosystème massif de données de l’entreprise.

Anthropic ne pouvait pas indéfiniment rester en retrait de cette tendance sans risquer de voir ses modèles perdre en compétitivité. Les experts du secteur estiment que l’accès à des données conversationnelles diversifiées peut améliorer les performances d’un modèle de 15 à 20%.

Cette évolution s’inscrit dans une logique économique claire : plus les modèles sont performants, plus ils attirent d’utilisateurs payants. Pour les entreprises du secteur, c’est un cercle vertueux qui justifie ces changements de politique, même s’ils peuvent déplaire aux utilisateurs soucieux de confidentialité.

En tant que dirigeant d’entreprise, vous vous demandez peut-être si cette course à la performance vaut vraiment le sacrifice de vos données sensibles – une question légitime qui mérite une réponse stratégique.

Les risques pour les entreprises belges utilisant Claude

L’utilisation de Claude en contexte professionnel expose désormais les entreprises belges à plusieurs risques significatifs qu’il convient d’évaluer soigneusement.

Le premier concerne la confidentialité des informations stratégiques. Vos discussions sur de nouveaux produits, vos analyses de marché ou vos processus internes peuvent potentiellement être analysées et, indirectement, bénéficier à vos concurrents utilisant les mêmes outils d’IA.

La propriété intellectuelle représente un enjeu majeur. Si vous utilisez Claude pour affiner des brevets, développer des innovations ou analyser des données clients, ces informations pourraient contribuer à l’entraînement d’un modèle accessible à tous. Un paradoxe qui pourrait affaiblir votre avantage concurrentiel.

Les implications légales ne sont pas négligeables non plus. Le RGPD européen impose des obligations strictes sur le traitement des données personnelles. Utiliser un service qui collecte potentiellement des données clients pour ses propres fins pourrait vous exposer à des sanctions.

Enfin, la réputation de votre entreprise pourrait pâtir d’une fuite accidentelle d’informations sensibles. Même si Anthropic affirme protéger les données collectées, aucun système n’est infaillible, comme l’ont démontré plusieurs incidents récents dans le secteur technologique.

Comment protéger vos données d’entreprise dès maintenant

Heureusement, des solutions concrètes existent pour continuer à bénéficier de Claude tout en protégeant vos données sensibles.

La première étape consiste à désactiver la collecte de données dans vos paramètres Claude. Rendez-vous dans la section « Privacy » de votre compte et décochez l’option « Improve Claude ». Cette manipulation simple mais cruciale empêche l’utilisation de vos conversations pour l’entraînement.

Établissez ensuite une politique d’usage claire au sein de votre équipe. Définissez quelles informations peuvent être partagées avec des IA externes et lesquelles doivent rester confidentielles. Une charte d’utilisation évite les mauvaises surprises.

Pour les données vraiment sensibles, privilégiez des solutions d’IA privées ou des instances dédiées. Plusieurs prestataires proposent des déploiements sécurisés qui garantissent que vos données restent dans votre environnement.

Considérez également l’usage d’outils de anonymisation avant de soumettre des données à des IA externes. Remplacez les noms clients, les montants précis ou les informations stratégiques par des variables génériques qui préservent l’utilité de l’analyse sans exposer d’informations critiques.

Après tout, mieux vaut prévenir que de se retrouver à expliquer à vos clients pourquoi leurs données se baladent dans les serveurs d’une IA américaine !

Vers une approche plus sécurisée de l’IA en entreprise

L’avenir de l’IA en entreprise se dessine autour de solutions hybrides qui concilient performance et sécurité. Les entreprises belges les plus avancées adoptent déjà des stratégies à plusieurs niveaux.

Les IA privées gagnent en popularité. Des solutions comme Azure OpenAI Service ou AWS Bedrock permettent de déployer des modèles performants dans votre propre environnement cloud, garantissant un contrôle total sur vos données.

L’automatisation intelligente représente également une opportunité majeure. Plutôt que d’exposer toutes vos données à des IA externes, vous pouvez développer des processus automatisés spécifiques qui traitent vos informations en interne tout en bénéficiant de capacités d’IA avancées.

La gouvernance des données devient un avantage concurrentiel. Les entreprises qui maîtrisent leurs flux d’informations et implémentent des politiques d’IA rigoureuses prennent une longueur d’avance sur leurs concurrents moins structurés.

L’investissement dans des compétences internes s’avère également payant. Former vos équipes aux bonnes pratiques de l’IA et développer une expertise interne vous permet de réduire votre dépendance aux solutions externes tout en maximisant les bénéfices de ces technologies.

La collecte de données par Anthropic illustre parfaitement l’importance d’une stratégie IA réfléchie pour protéger vos actifs tout en innovant. Nous accompagnons les entreprises belges dans cette transformation digitale sécurisée.

Échangeons sur vos enjeux d’automatisation et d’IA :

📧 contact@bescott.be

📞 +32 479 57 48 27

🌐 Nos services IA