Panique à bord chez le géant de l’IA : OpenAI aurait-il vraiment laissé fuiter nos données confidentielles ?

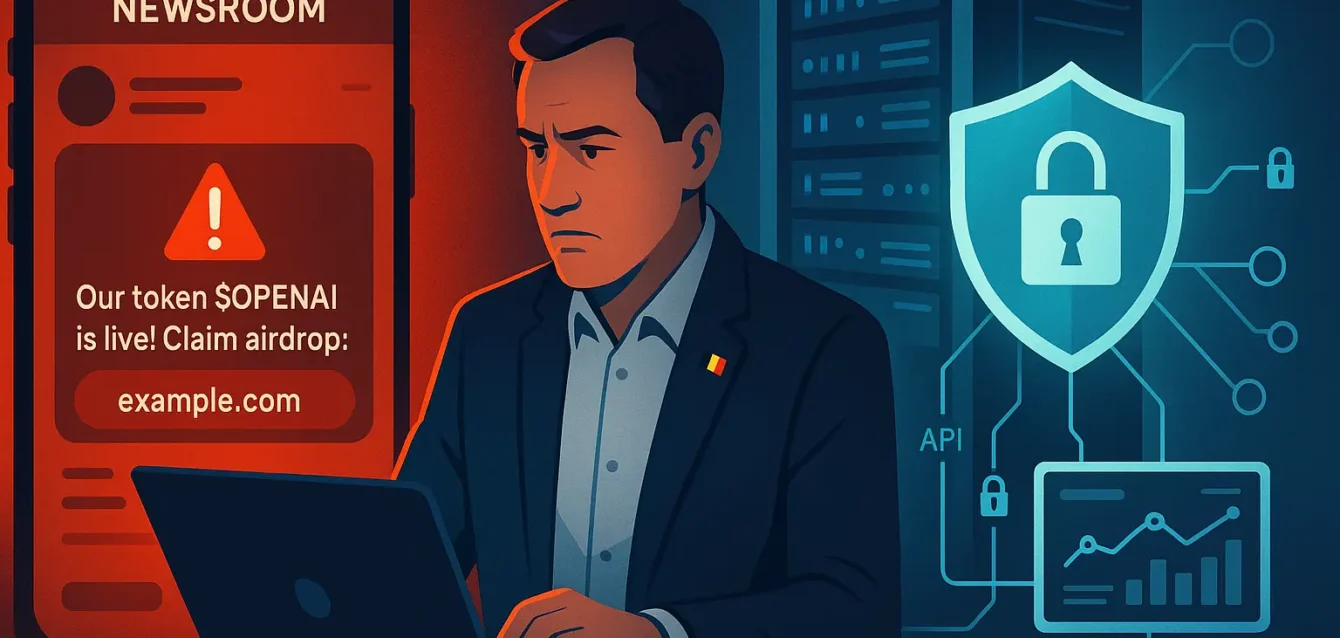

Ce lundi, une notification a fait trembler la sphère tech : le compte officiel de la newsroom d’OpenAI annonçait une brèche de sécurité majeure. Dans un monde où l’IA et l’automatisation sont devenues les moteurs de la croissance des entreprises, une telle nouvelle a de quoi donner des sueurs froides à n’importe quel CEO. Mais derrière ce titre alarmiste se cache une réalité bien différente, riche d’enseignements pour votre propre sécurité numérique.

À retenir

- Fausse alerte infrastructurelle : Les serveurs et modèles d’IA d’OpenAI n’ont pas été compromis ; c’est le compte X (Twitter) de leur service communication qui a été piraté.

- L’arnaque Crypto : Les pirates ont utilisé cette brèche pour promouvoir un faux jeton de cryptomonnaie, le « $OPENAI », incitant les utilisateurs à cliquer sur un lien de phishing.

- Le facteur humain : Cet incident rappelle que la faille se situe souvent au niveau des accès réseaux sociaux et non dans la technologie IA elle-même.

- Sécurité des API : Pour les entreprises, l’utilisation de l’IA via des API sécurisées reste bien plus sûre que les interfaces grand public.

- Vigilance constante : Même les leaders de la tech ne sont pas à l’abri d’une attaque par ingénierie sociale.

Table des matières

- Anatomie d’une « fausse » fuite de données

- IA et Cybersécurité : Distinguer le risque réel du bruit médiatique

- Pourquoi l’automatisation via API est votre meilleur bouclier

- La gouvernance des données : Un impératif pour les dirigeants belges

Anatomie d’une « fausse » fuite de données

Lundi soir, le compte @OpenAINewsroom publiait un message alarmant invitant les utilisateurs à cliquer sur un lien pour vérifier s’ils étaient touchés par une prétendue fuite. En réalité, il n’y avait aucune fuite de données sur les serveurs d’OpenAI.

Ce qui s’est réellement passé, c’est une prise de contrôle classique d’un compte de réseau social. Des hackers ont détourné la crédibilité de la marque pour lancer une arnaque au phishing (hameçonnage), promettant un faux token crypto en dédommagement. C’est un scénario que nous voyons malheureusement trop souvent : la technologie sous-jacente est robuste, mais les points d’entrée périphériques (comme un compte marketing) sont vulnérables.

Pour nous, experts en intégration, cet événement souligne une distinction cruciale. Il ne faut pas confondre la sécurité des modèles d’intelligence artificielle (qui traitent vos données d’entreprise) avec la sécurité des canaux de communication de l’éditeur. Vos processus automatisés n’étaient pas en danger, seuls les portefeuilles crypto des internautes trop crédules l’étaient.

IA et Cybersécurité : Distinguer le risque réel du bruit médiatique

En tant que dirigeant d’entreprise en Belgique, il est facile de se sentir dépassé par ces gros titres. Doit-on stopper l’intégration de l’IA par peur du piratage ? Absolument pas.

Les statistiques sont claires : selon le rapport d’IBM sur le coût des violations de données, 95 % des brèches de cybersécurité sont dues à une erreur humaine. Dans le cas d’OpenAI, c’est probablement un mot de passe faible ou une absence de double authentification (2FA) sur un compte Twitter qui a causé le problème.

L’adoption de solutions d’IA et d’automatisation ne crée pas de nouvelles failles si elle est bien encadrée ; au contraire, elle permet souvent de réduire le facteur humain, source principale d’erreurs. Avouons-le, nous avons tous ce collègue qui utilise « Soleil123 » comme mot de passe pour tout, de sa boîte mail à la banque en ligne. L’automatisation permet de limiter les interventions manuelles sur les données sensibles, réduisant ainsi la surface d’attaque potentielle liée à la fatigue ou à l’inattention humaine.

Pourquoi l’automatisation via API est votre meilleur bouclier

C’est ici que notre expertise prend tout son sens. Beaucoup d’entreprises craignent d’utiliser l’IA (comme ChatGPT) en pensant que leurs données vont « fuiter » dans le domaine public pour entraîner les modèles.

Il est impératif de distinguer l’usage « grand public » (le chat gratuit) de l’usage « professionnel » (via API). Lorsque nous mettons en place des automatisations pour nos clients, nous utilisons exclusivement les API d’entreprise (OpenAI, Anthropic, etc.).

Pourquoi est-ce plus sûr ?

- Confidentialité contractuelle : Les données envoyées via API ne sont pas utilisées par OpenAI pour entraîner leurs futurs modèles (contrairement à la version gratuite).

- Contrôle des flux : Les données transitent de serveur à serveur, sans interface humaine susceptible d’être hameçonnée par un tweet frauduleux.

- Gouvernance : Nous pouvons crypter, anonymiser ou filtrer les données avant même qu’elles ne soient traitées par l’IA.

En résumé, une architecture d’automatisation bien pensée est souvent plus étanche qu’un fichier Excel envoyé par email.

La gouvernance des données : Un impératif pour les dirigeants belges

Cet incident chez OpenAI est un rappel salutaire pour les PME et indépendants belges. La sécurité n’est pas un produit que l’on achète, c’est un processus. L’intégration de l’IA dans vos processus métier offre un levier de productivité immense, mais elle doit s’accompagner d’une hygiène numérique irréprochable.

Voici ce que nous recommandons systématiquement lors de nos audits :

- Sécurisez les accès périphériques : Activez la double authentification partout. Un compte marketing piraté peut faire autant de dégâts réputationnels qu’une faille serveur.

- Formez vos équipes : L’IA peut rédiger vos emails, mais elle ne peut pas (encore) empêcher un employé de cliquer sur un lien suspect promettant des cryptos gratuites.

- Faites appel à des experts : L’automatisation « bricolée » sur un coin de table présente des risques. Une architecture professionnelle garantit que vos données restent vos données.

L’incident d’OpenAI n’était qu’un écran de fumée pour une arnaque financière, mais il nous rappelle que dans la course à l’innovation, la confiance est la monnaie la plus précieuse.

Conclusion

L’annonce de cette « fuite » chez OpenAI s’avère être une frayeur plus médiatique que technique, mais elle valide une stratégie essentielle : l’importance de construire vos systèmes d’IA sur des bases solides et professionnelles. L’automatisation est un atout concurrentiel majeur pour les entreprises belges, à condition d’être déployée avec rigueur et sécurité via des API protégées.

Vous souhaitez sécuriser vos processus tout en boostant votre productivité grâce à l’IA ? Discutons-en autour d’un café (réel ou virtuel).

📧 contact@bescott.be

📞 +32 479 57 48 27

🌐 Nos services IA